Configurer le réseau sur Proxmox VE sur les gammes High Grade, Scale & Advance

Les rubriques relatives aux serveurs de la gamme Advance s’appliquent uniquement aux serveurs Advance de troisième génération équipés de processeurs EPYC 4004 Series.

Les générations de serveurs Advance plus anciennes ne reposent pas sur la même infrastructure réseau.

Cet article concerne la configuration d'adresses Additional IPv4 sur une interface publique. Vous pouvez également configurer des adresses Additional IPv6 sur vos machines virtuelles en utilisant ce guide.

Veuillez noter que les Additional IP peuvent également être configurées dans un vRack (réseau privé), ce qui permet d'interconnecter une large gamme de services OVHcloud, offrant plus de flexibilité.

Apprenez à configurer des Additional IP dans un vRack avec nos guides pour IPv4 et IPv6.

Depuis mai 2025, les adresses MAC virtuelles peuvent être utilisées sur les serveurs des gammes High Grade et Scale.

Si vous souhaitez utiliser des adresses MAC virtuelles pour configurer le réseau sur Proxmox VE sur vos serveurs des gammes High Grade et Scale, vous pouvez vous référer au guide sur la configuration des Additional IP en mode network bridge.

Objectif

Découvrez deux manières de configurer une Additional IP sous Proxmox VE : via les interfaces publiques et via les interfaces privées (vRack).

Prérequis

- Un serveur dédié OVHcloud

- Une ou plusieurs adresses Additional IP

Aucune MAC virtuelle ne doit être appliquée sur les Additional IP dans l'espace client OVHcloud.

En pratique

Additional IP en mode routé sur les interfaces réseau publiques

Avec cette configuration, les adresses Additional IP doivent être attachées à un serveur dédié. Si vous disposez de plusieurs serveurs de virtualisation Proxmox et que vous souhaitez migrer une VM d'un serveur à l'autre, vous devrez également migrer l'adresse Additional IP vers le serveur de destination, via l'espace client OVHcloud ou via l'API OVHcloud. Vous pouvez automatiser cette étape en écrivant un script qui utilise les API d'OVHcloud.

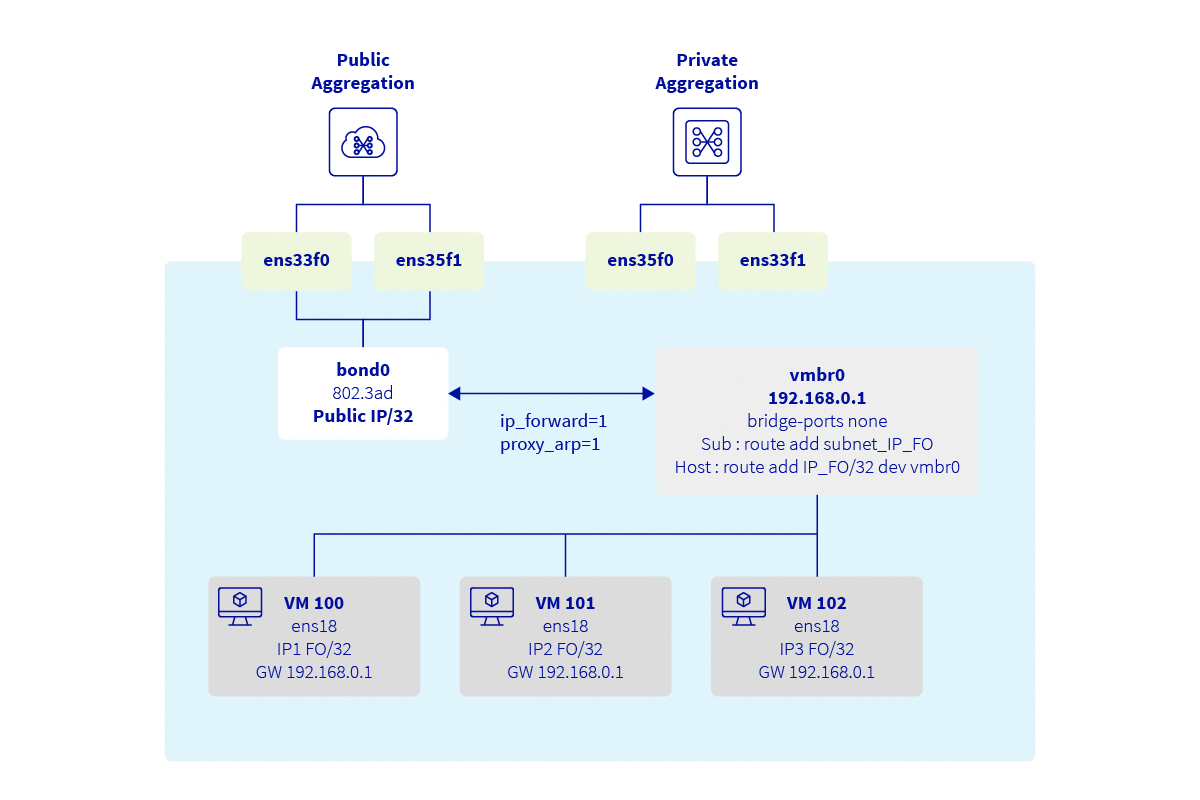

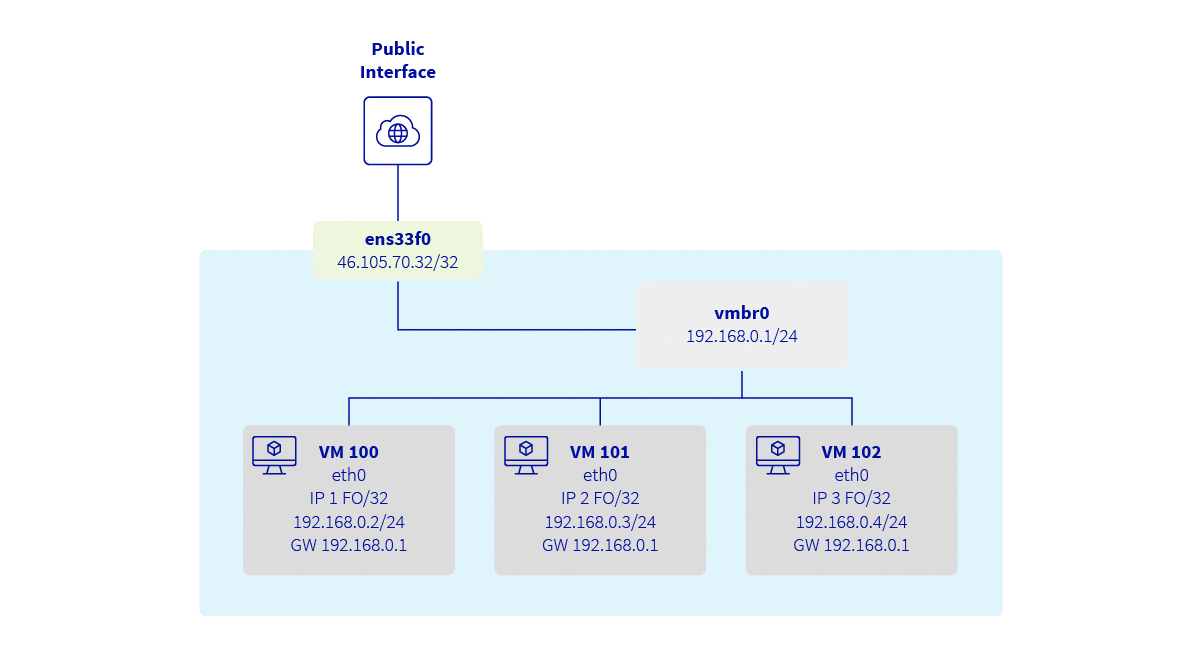

Schéma de la configuration cible

Explications

Proxmox est une distribution basée sur Debian qui s'appuie sur ifupdown2 pour la configuration réseau. Dans ce guide, la configuration réseau sera modifiée via SSH et non via l'interface Web.

Les étapes ci-dessous décrivent successivement comment :

- se connecter en SSH sur Proxmox ;

- créer une interface d'agrégation (bond) (uniquement pour les gammes High Grade & Scale) ;

- créer une interface bridge connectée au bond ;

- autoriser le routage de paquets entre les interfaces ;

- ajouter des routes vers les Additional IP.

Configurer l'hyperviseur

Connectez-vous au serveur Proxmox via SSH :

Autoriser le routage de paquets

Activez le paramètre sysctl ip_forward. Pour cela, nous vous recommandons de modifier le fichier de configuration sysctl.conf.

Ajoutez la ligne suivante à /etc/sysctl.conf :

Rechargez ensuite la configuration sysctl :

Configurer les interfaces réseau

À ce stade, redémarrez les services réseau :

Lorsque les services réseau sont redémarrés, les VM ne sont pas ajoutées au bridge. En effet, Proxmox déconnecte chaque VM des bridges et ne les reconnecte pas. Pour forcer la reconnexion des VM aux bridges, vous pouvez redémarrer les VM.

Exemple de configuration VM cliente

La VM doit être attachée au bridge vmbr0.

Contenu du fichier /etc/network/interfaces :

Contenu du fichier /etc/netplan/01-netcfg.yaml :

Test et validation

Dorénavant, vos machines virtuelles devraient pouvoir accéder à Internet depuis les adresses Additional IP. Elles doivent également être accessibles directement depuis Internet via leurs adresses Additional IP. La bande passante disponible correspond à la bande passante disponible sur les interfaces publiques de votre serveur et n'affectera pas les interfaces privées utilisées pour le vRack. Cette bande passante publique est partagée avec d’autres machines virtuelles sur le même hôte, ainsi qu’avec l’hôte Proxmox lui-même.

Pour vérifier votre IP publique, depuis la VM :

Vous devez redémarrer les services réseau de la VM pour que la configuration soit prise en compte.

Additional IP via le vRack

Cette configuration est plus souple car il n'est pas nécessaire d'associer une Additional IP à un serveur, mais à un vRack. Cela signifie que si vous disposez de plusieurs serveurs de virtualisation Proxmox et que vous souhaitez migrer une machine virtuelle d'un serveur à un autre, vous n'avez pas besoin d'effectuer d'action via les API OVHcloud. La seule condition est que tous les serveurs soient connectés au même vRack.

Cette configuration ne fonctionne qu'avec un bloc d'Additional IP. Il n'est pas possible d'utiliser une seule Additional IP (/32) directement dans le vRack. Pour utiliser une Additional IP, elle doit être configurée sur une interface publique et ne peut pas être directement intégrée au vRack.

Prérequis

- Un serveur compatible avec le vRack

- Un service vRack

- Un bloc d'additional IP

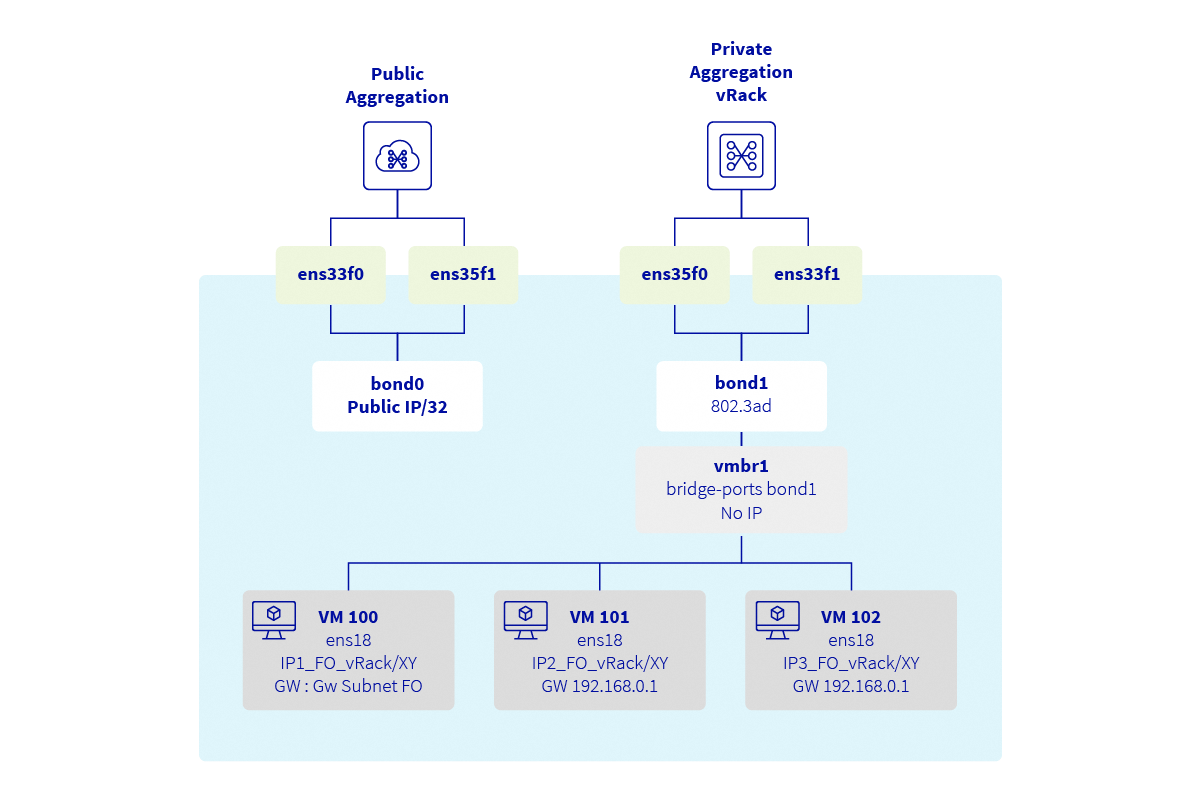

Schéma de la configuration cible

Explications

Proxmox est une distribution basée sur Debian qui s'appuie sur ifupdown2 pour la configuration réseau. Dans ce guide, la modification de la configuration réseau se fera en SSH et non via l'interface Web.

Nous allons :

- créer une interface d'agrégation (bond) (uniquement pour les gammes High Grade & SCALE) ;

- créer une interface bridge connectée au bond.

Premièrement, ajoutez votre bloc d'Additional IP au vRack. Pour ce faire, allez dans la section Bare Metal Cloud de votre espace client OVHcloud et ouvrez le menu vRack.

Sélectionnez votre vRack dans la liste pour afficher la liste des services éligibles. Cliquez sur le bloc d'Additional IP que vous souhaitez ajouter au vRack, puis cliquez sur le bouton Ajouter.

Déterminer les adresses IP assignables

Lorsqu'elles sont utilisées dans un vRack, la première, l'avant-dernière et la dernière adresses d'un bloc d'IP donné sont toujours réservées respectivement à l'adresse réseau, la passerelle réseau et au broadcast du réseau. Cela signifie que la première adresse assignable est la deuxième adresse du bloc, comme indiqué dans l'exemple ci-dessous pour le bloc 46.105.135.96/28 :

Le masque de sous-réseau utilisé dans cet exemple est adapté à notre bloc d'Additional IP. Votre masque de sous-réseau peut différer en fonction de la taille de votre bloc. Lorsque vous achetez votre bloc d'IP, vous recevez un e-mail vous indiquant le masque de sous-réseau à utiliser.

Configurer l'hyperviseur

Connectez-vous au serveur Proxmox en SSH :

À ce stade, redémarrez les services réseau :

Lorsque les services réseau sont redémarrés, les VM ne sont pas ajoutées au bridge. En effet, Proxmox déconnecte chaque VM des bridges et ne les reconnecte pas. Pour forcer la reconnexion des VM aux bridges, vous pouvez redémarrer les VM.

Exemple de configuration VM cliente

La VM doit être attachée au bridge vmbr1.

Contenu du fichier /etc/network/interfaces :

Contenu du fichier /etc/netplan/01-netcfg.yaml :

Test et validation

Dorénavant, vos machines virtuelles devraient pouvoir accéder à Internet depuis les adresses Additional IP. Elles doivent également être accessibles directement depuis Internet via leurs adresses Additional IP.

Pour vérifier votre IP publique, depuis la VM :

Vous devez redémarrer les services réseau de la VM pour que la configuration soit prise en compte.

Aller plus loin

Configurer le réseau sur Windows Server avec Hyper-V

Mise à niveau du matériel sur un serveur dédié High Grade ou Scale

Échangez avec notre communauté d'utilisateurs.