Configuration du stockage d'un serveur HGR-STOR-2

Objectif

Votre serveur HGR-STOR-2 présente les mêmes disques sous différents périphérique logiques (devices) du système d'exploitation.

En fonction des systèmes, sans post-configuration spécifique, cette architecture peut être source de confusion (où sont mes données ?) ou même de collisions (accès involontaire au même disque physique pour des usages différents), ce qui pourrait causer la perte de vos données.

En fonction de votre système, une post-configuration peut être nécessaire afin de mettre en place les fonctionnalités multipath.

Le Multipath permet d’agréger les différentes possibilités d'accès au même disque (path) en tant que device logique unique.

Cette documentation détaille :

- les templates OVHcloud compatibles (testés par nos équipes);

- le mode opératoire de post-configuration par OS.

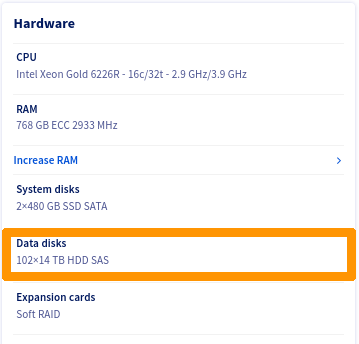

- Ce guide documente une configuration disposant de 102 disques mais les informations sont également valables pour les autres configurations.

- La configuration présentée dans ce guide n'est pas équipée de disques NVMe (ceux-ci sont optionnels).

- Vous ne trouverez que les versions les plus récentes des systèmes.

- Toutes les versions Debian testées ne détectent que 2 chemins et non 4, ce qui amènerait des collisions au niveau LVM notamment.

Prérequis

- Disposer d'un serveur de type HGR-STOR-2

En pratique

Le serveur, en plus de ses disques internes, expose jusqu'à 102 Disques de 14 To de type SAS.

Les disques de stockages disposent de :

- 2 accès internes;

- 2 accès via contrôleur SAS.

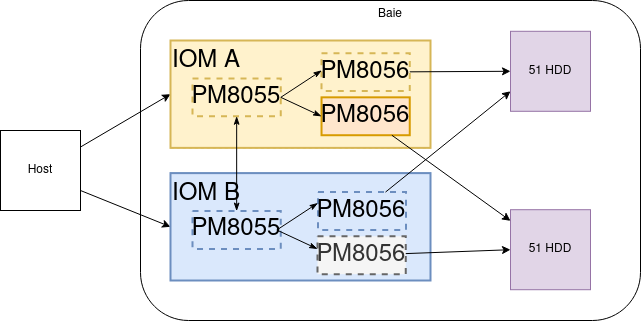

Il y a donc en tout 4 manières d'accéder à un disque:

- Contrôleur SAS 1 - Chemin 1-> Disque

- Contrôleur SAS 1 - Chemin 2-> Disque

- Contrôleur SAS 2 - Chemin 1-> Disque

- Contrôleur SAS 2 - Chemin 2-> Disque

Voici une vue logique :

Liste des templates OVHcloud

| Template | Procédure | Remarques |

|---|---|---|

| ESXi 7 | Procédure pour ESXI-7 | |

| AlmaLinux 8 | Procédure pour AlmaLinux 8, Rocky Linux 8, Fedora 34 Server | |

| Rocky Linux 8 | Procédure pour AlmaLinux 8, Rocky Linux 8, Fedora 34 Server | |

| Fedora 34 Server | Procédure pour AlmaLinux 8, Rocky Linux 8, Fedora 34 Server | |

| Proxmox VE 7 | Procédure pour Proxmox VE 7 | |

| Ubuntu Server 22.04 LTS | Procédure pour Ubuntu Server 22.04 LTS | |

| Debian toutes versions | Non supportée | Ne détecte que la moitié des chemins |

| Windows Server 2019 | Procédure pour Windows |

Avertissement concernant LVM sur Linux

Ne créez vos PV que sur les devices en multipath de type /dev/mapper/mpathXX.

Exemple :

- Création des PVs :

- Création d'un VG :

- Création d'un LV :

Avertissement concernant ZFS sur Linux

Ne créez vos zfspool que sur les devices en multipath de type /dev/mapper/mpathXX.

Exemple :

ESXi-7

ESXi n'a pas besoin d'installation de composants supplémentaires, le multipath est automatiquement géré.

Si nécessaire, vous pouvez procéder aux vérifications décrites ci-dessous.

Vérifications

Connectez-vous via SSH en shell sur votre ESXi.

Liste des adaptateurs

Vérifiez que ESXi a bien détecté les deux contrôleurs SAS de types similaires à ce qui suit :

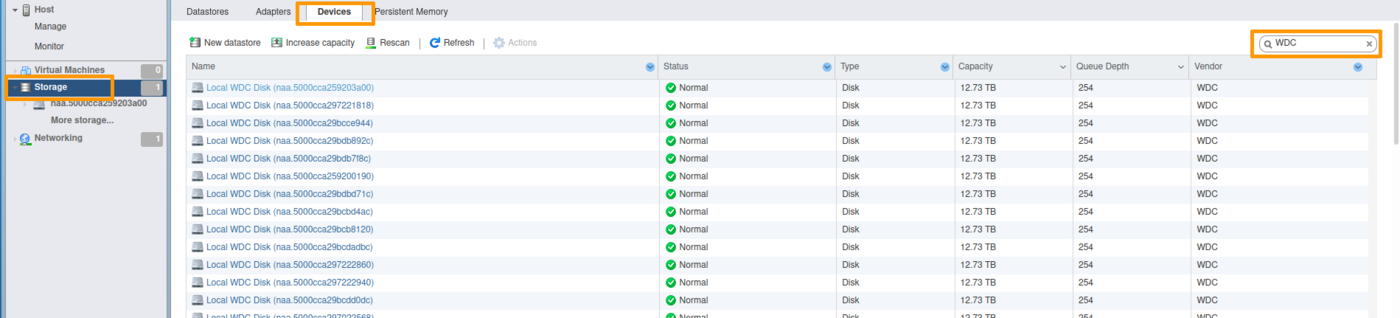

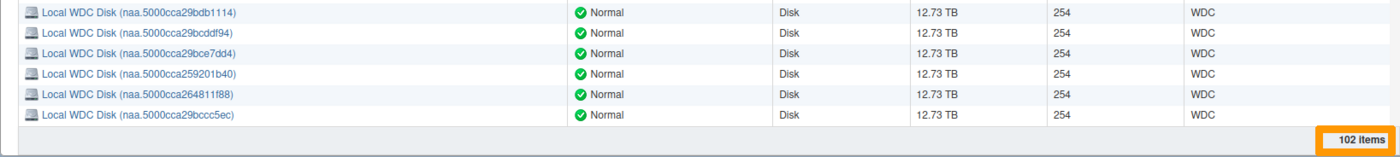

Liste des disques

Vous devez voir 102 ou 50 disques.

Détails du multipath

Afin de ne pas surcharger inutilement cette documentation, nous n'affichons qu'un des éléments retournés.

On note que pour chaque device, il existe bien 4 chemins d'accès (ligne Paths).

- Disque vu par le système :

Local WDC Disk (naa.5000cca259203a00) - Deux contrôleurs :

vmhba2et _vmhba3 - Deux disques terminaux:

T72etT175

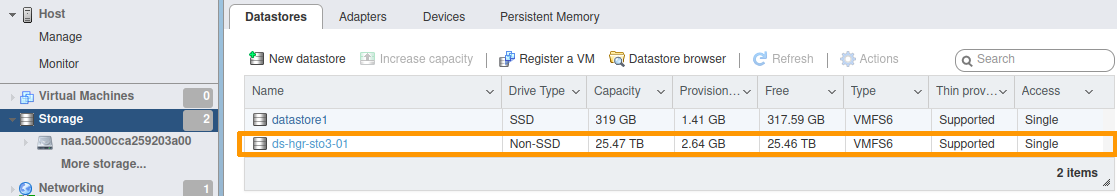

Vue via l'interface WEB

Sélectionnez Storage puis l'onglet Devices.

Filtrez les résultats avec le mot-clé WDC.

Descendez en bas de la liste, vous devez avoir un décompte de 102 disques (ou 50, en fonction de la configuration utilisée).

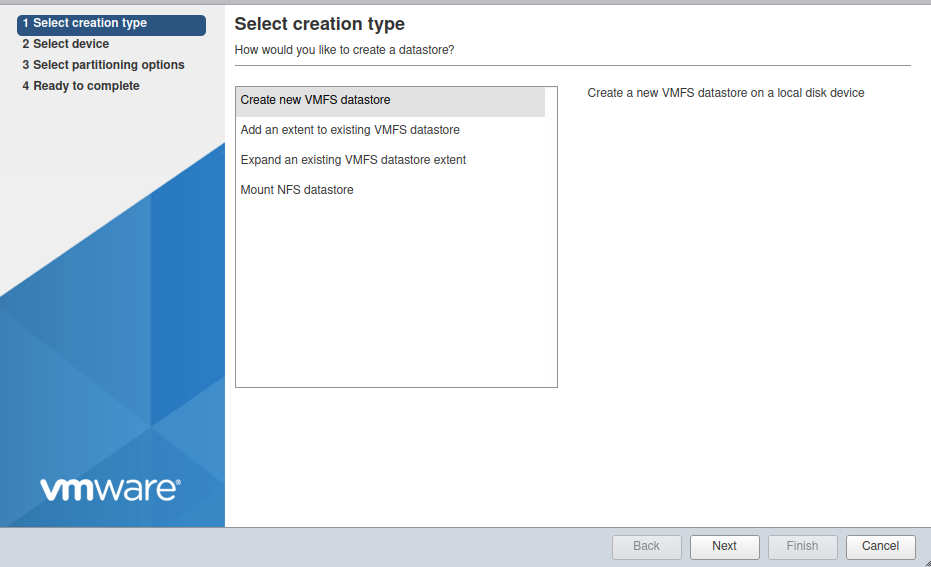

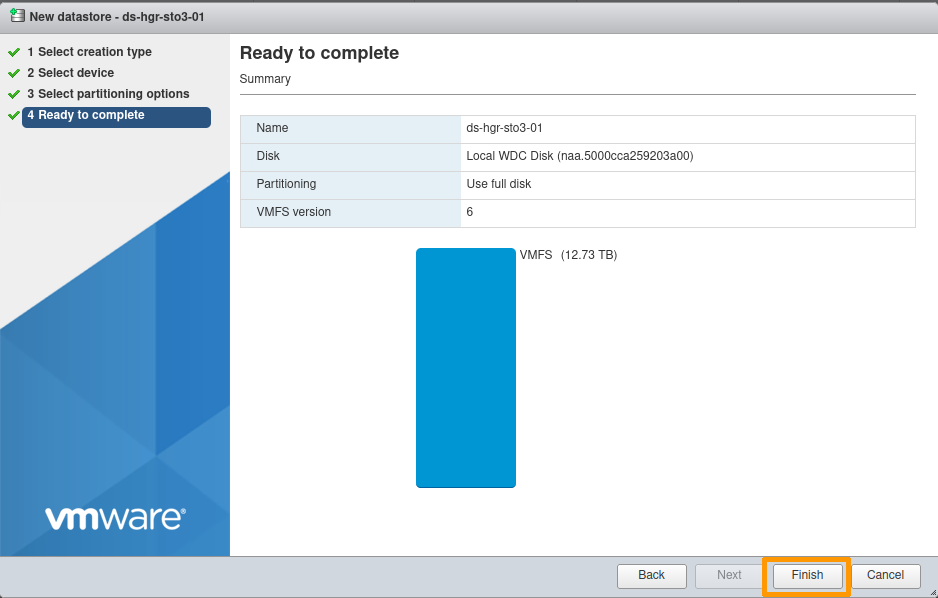

Ajout d'un Datastore

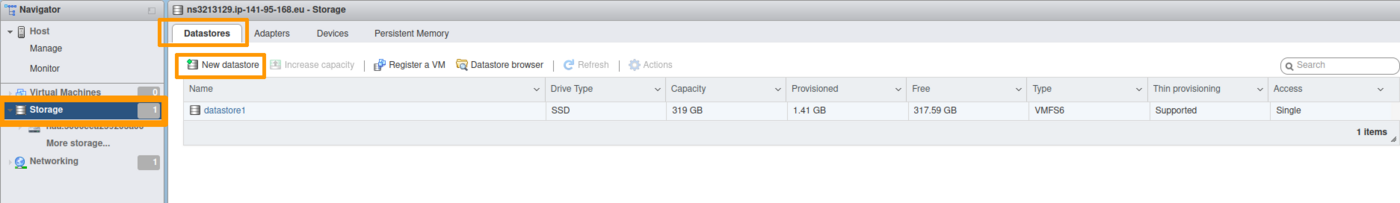

Sélectionnez Storage puis l'onglet Datastores.

Cliquez sur l’icône New datastore.

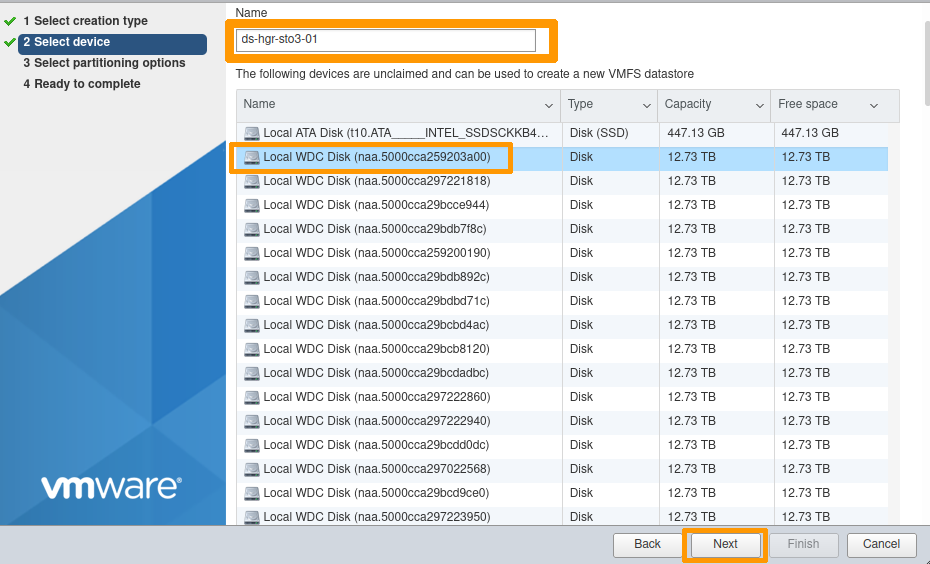

Nommez votre Datastore à votre convenance (ds-hgr-sto3-01 dans l'exemple ci-dessous).

Sélectionnez l'un des disques présentés.

Les disques présentés par le HGR-STOR-2 sont nommés Local WDC Disk (naa.xxxxxxxxxxxx).

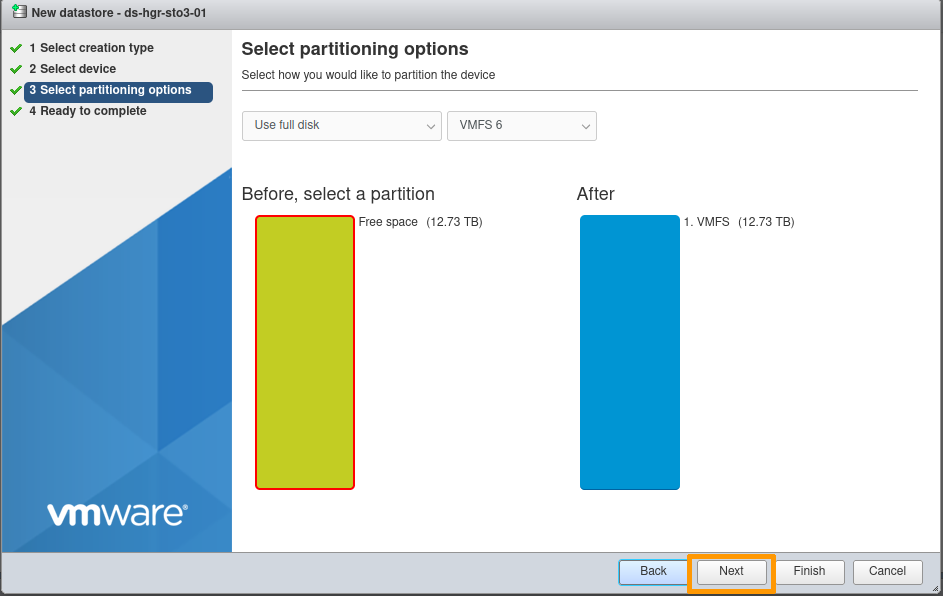

Options de partitionnement :

Par défaut, tout le disque est attribué (pas de partitionnement).

Validation finale :

A ce stade, vous pouvez modifier vos choix ou annuler la création du Datastore si besoin.

Dans le cas contraire, cliquez sur Finish.

Un message d'information vous rappele que le disque sélectionné sera entièrement effacé.

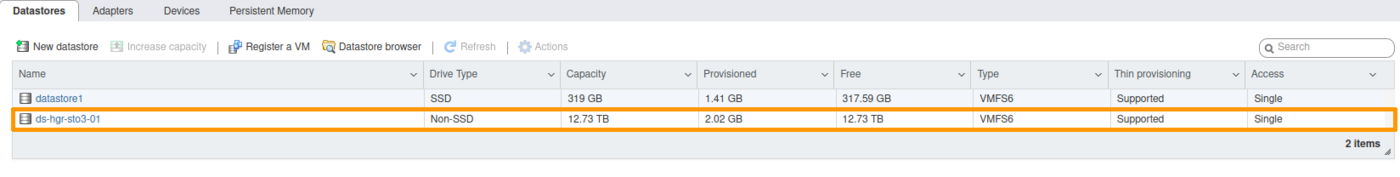

Votre Datastore est alors disponible.

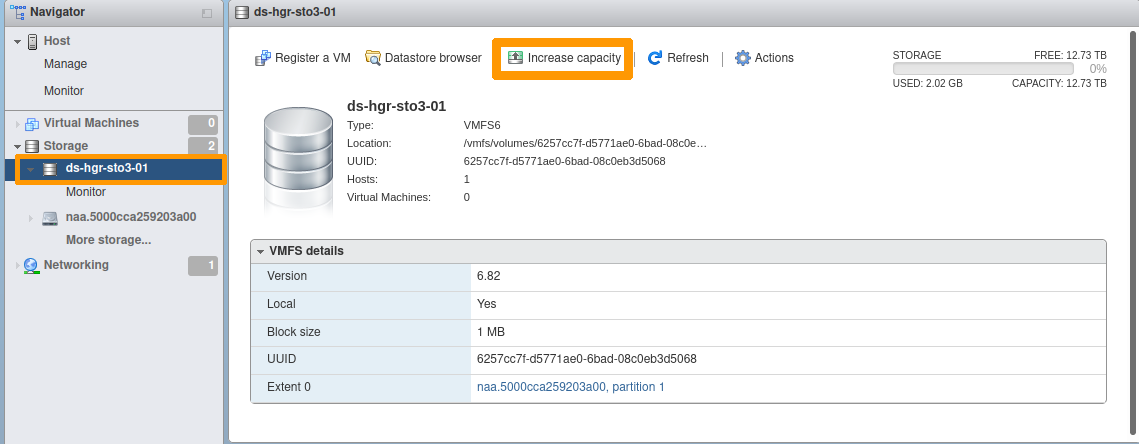

Extension d'un Datastore

Sélectionnez le datastore à étendre.

Cliquez sur l’icône Increase capacity.

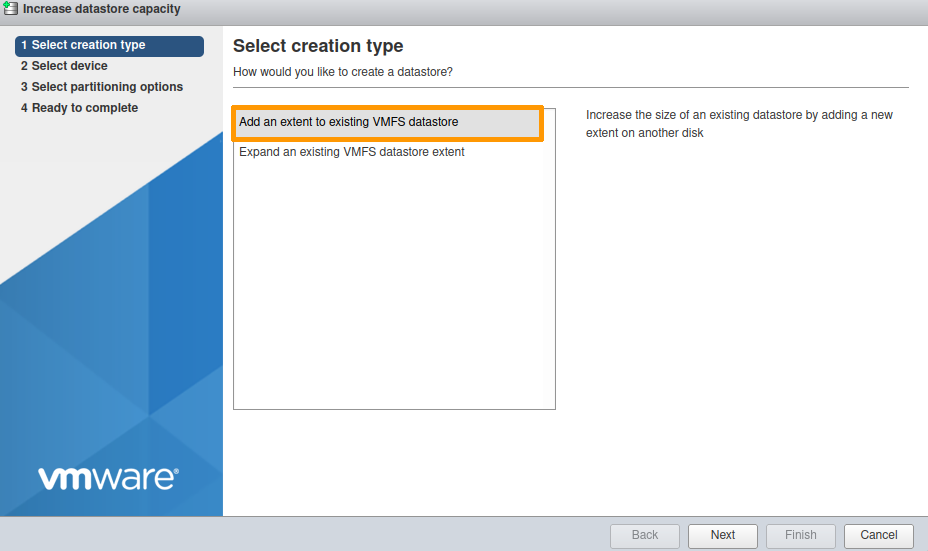

Sélectionnez Add an extent to existing VMFS datastore.

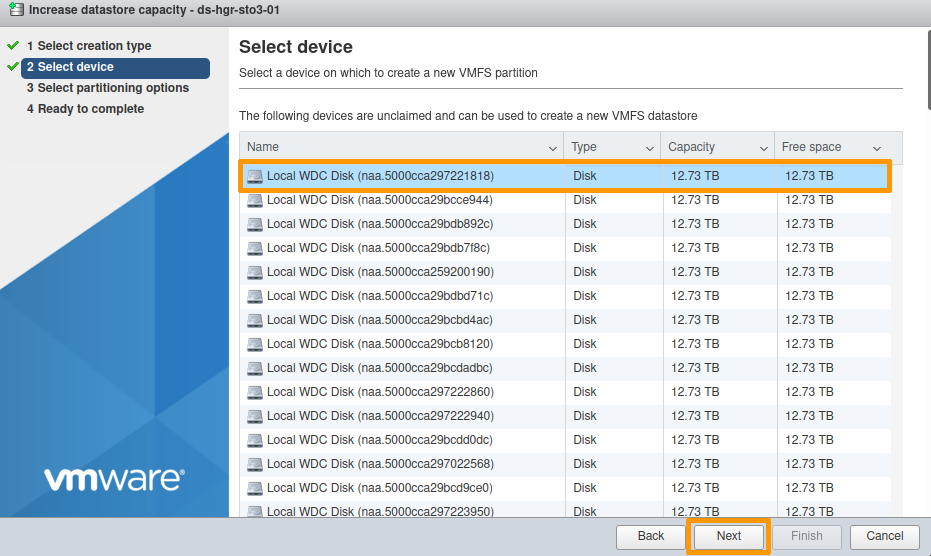

Sélectionner l'un des devices présentés.

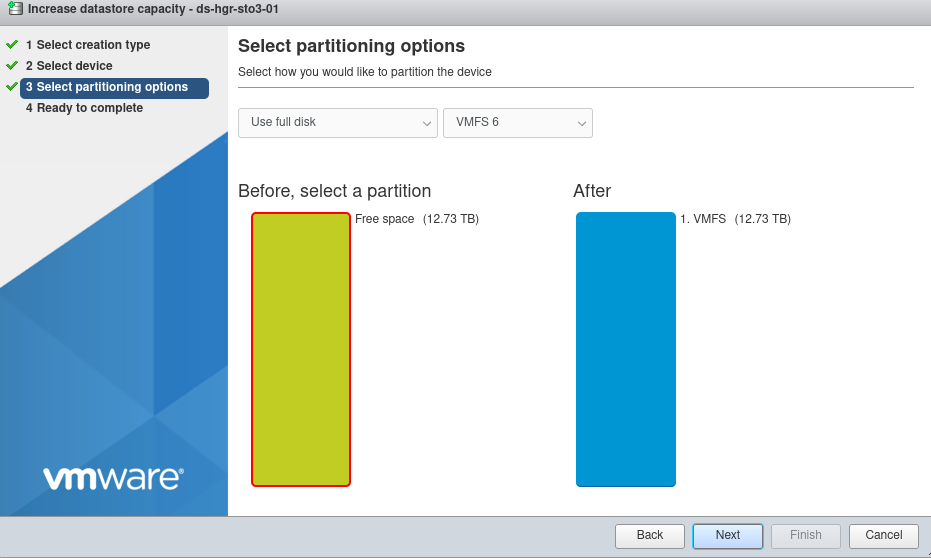

Par défaut, l'ensemble du disque sera utilisé.

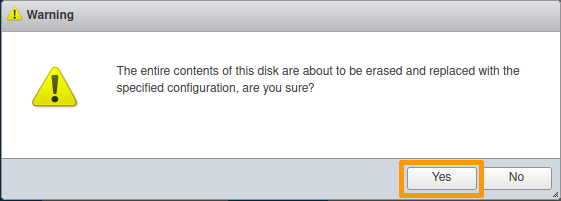

Un message d'information vous rappele que le disque sélectionné sera entièrement effacé.

Votre Datastore est alors étendu.

L'exemple ci-dessous documente une augmentation de 12.73 TB à 25.47 TB.

AlmaLinux 8, Rocky Linux 8, Fedora 34 Server

Post-configuration

Les paquets nécessaires sont déjà installés.

Exemple pour AlmaLinux :

En revanche, la configuration multipath reste à faire, le fichier /etc/multipath.conf n'étant pas présent.

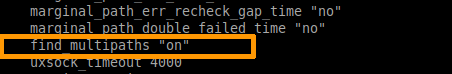

Configuration du service multipath

Activez le service :

Activez les options user_friendly_names ainsi que find_multipaths.

Redémarrez le service multipathd :

Vérifiez le bon statut du service multipathd :

Listez les devices multipath :

On constate que nous avons bien 4 chemins pour chaque device mpathXX listé.

Ubuntu Server 22.04 LTS

Post-configuration

Il n'y a pas de paquets additionnels à installer.

La configuration se fait automatiquement.

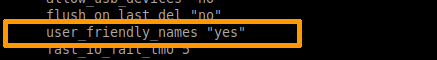

Proxmox VE 7

Post-configuration

Installez le paquet multipath-tools :

Générez la configuration initiale :

Éditez le fichier /etc/multipath.conf

- Modifiez l'option

find_multipathsàon.

- Modifiez l'option

use_friendly_namesàyes.

Sauvegardez le fichier /etc/multipath.conf puis redémarrez le service multipathd.

Vérifiez le statut du service multipathd :

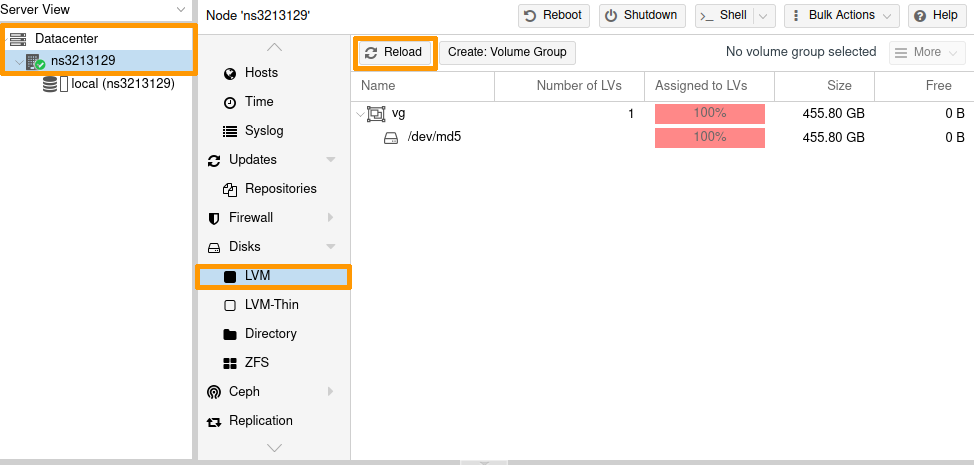

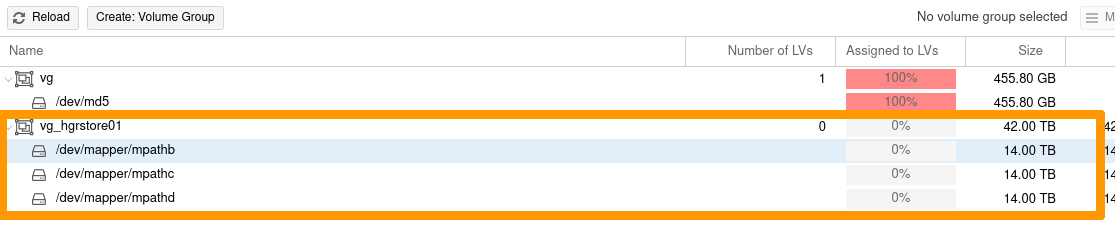

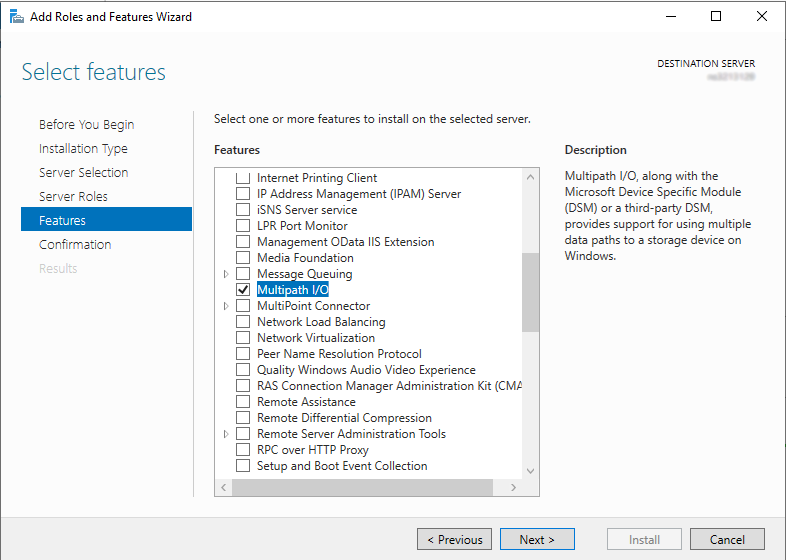

Ajout d'un node storage de type LVM sur Proxmox

Il est nécessaire de créer les Volumes Groupe (VG) manuellement afin que Proxmox puisse les utiliser.

Exemple : création d'un VG sur 3 PV multipath.

Ajout du storage node :

Dans l'interface Proxmox, sélectionnez votre node puis LVM.

Cliquez sur le bouton Reload.

Le nouveau VG est maintenant listé.

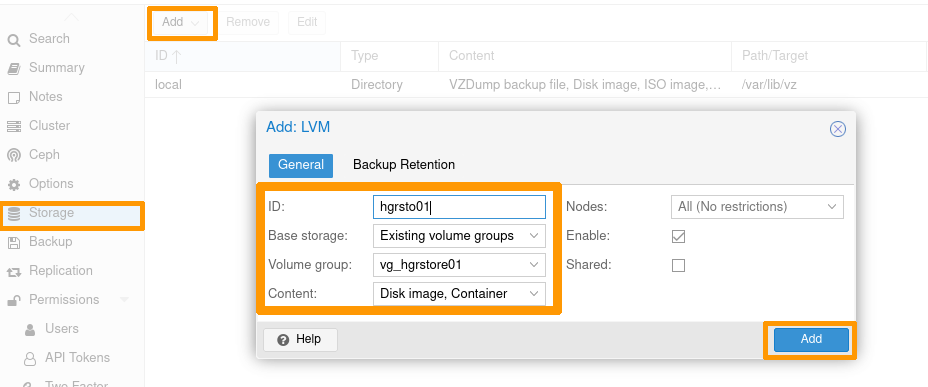

- Sélectionnez

Datacenter->Storage; - puis cliquez sur le bouton

Add->LVM; - renseignez l'ID avec le nom de votre stockage ainsi que le VG cible que vous venez de créer.

Une fois votre configuration définie, cliquez sur le bouton Add.

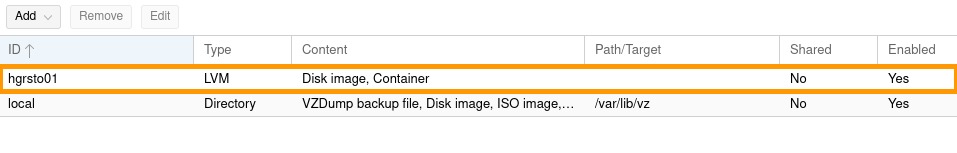

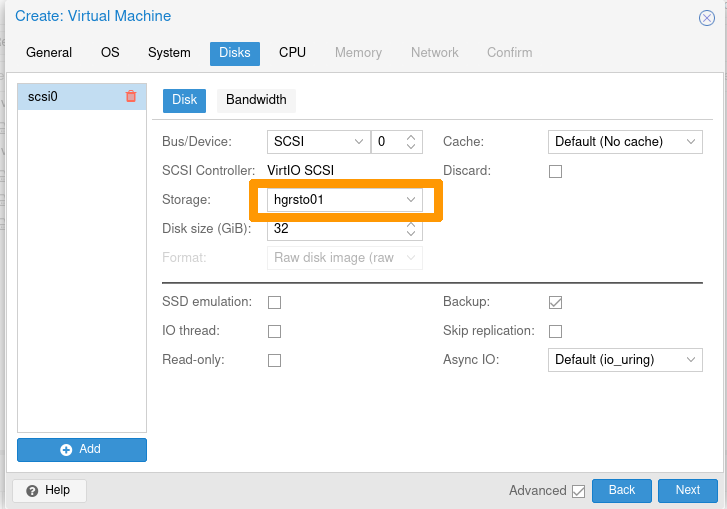

Le stockage est maintenant disponible.

Vous pouvez l'utiliser pour le déploiement de VMs ou autres.

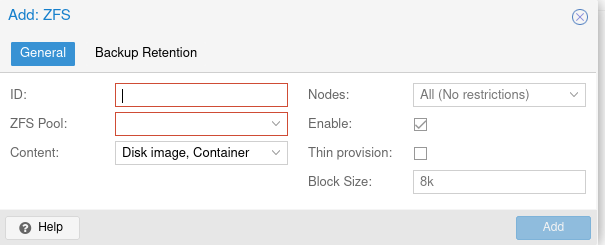

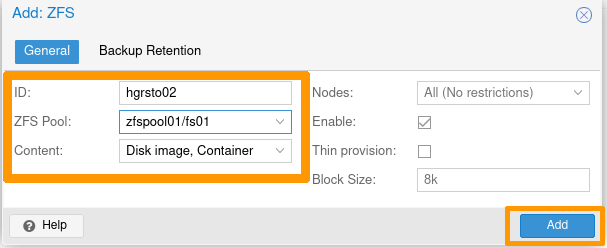

Ajout d'un node storage de type ZFS sur Proxmox

Il est nécessaire de créer les pools ZFS manuellement afin que Proxmox puisse les utiliser.

Exemple: création d'un pool sur 2 disques multipath.

Dans l'interface Proxmox:

- sélectionnez

Datacenter->Storage; - puis cliquez sur le bouton

Add->ZFS.

Renseignez l'ID avec le nom de votre stockage et sélectionnez l'un des ZFS Pools cibles que vous venez de créer.

Votre stockage Proxmox est maintenant utilisable.

Windows Server 2019

Post-configuration

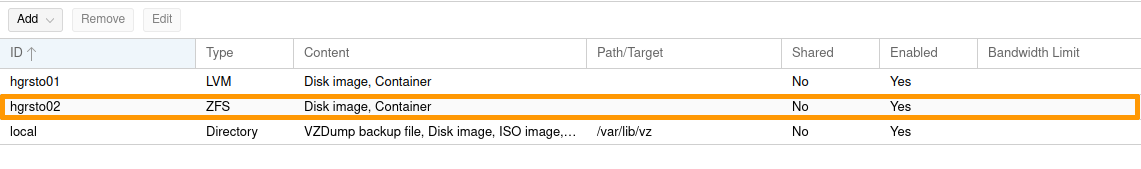

Etape 1 - Installation de la fonctionnalité MPIO

- Via Powershell

- Via Server Manager

Quelle que soit la méthode utilisée, redémarrez le serveur pour finaliser l'installation du composant.

Etape 2 - Ajout du stockage dans MPIO

- Via Powershell

Récupérez les informations du stockage VendorId et HardwareId :

Ajoutez le périphérique en utilisant les informations VendorId et HardwareId précédemment récupérées :

Vérifiez que le périphérique est maintenant bien pris en compte:

Le stockage par défaut Vendor 8 Product 16 n'est pas utilisé. Vous pouvez le laisser ou le retirer (dans ce dernier cas, utilisez la commande Remove-MSDSMSupportedHw).

- Via Server Manager

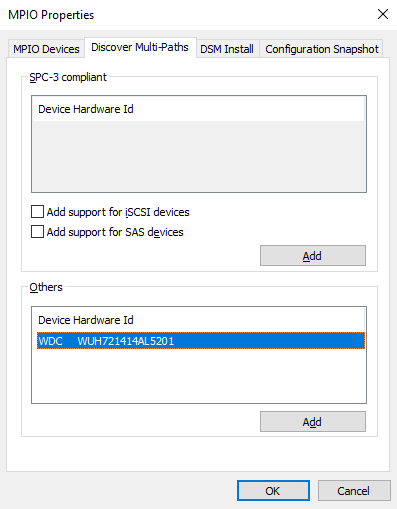

Lancez le panneau de contrôle MPIO. Pour cela, accédez au menu Démarrer et recherchez MPIO.

Dans l'onglet Discover Multi-Paths, sélectionnez le périphérique listé dans la fenètre Others puis ajoutez-le en cliquant sur le bouton Add:

Quelle que soit la méthode utilisée, redémarrez le serveur pour appliquer le changement de configuration.

Etape 3 - Configuration de la stratégie d'équilibrage (Policy) par défaut pour MPIO

- Via Powershell

Il s'agit de la méthode recommandée car l'utilisation de Server Manager vous obligera à définir la stratégie pour chaque disque.

Les stratégies (Policy) possibles sont :

| Policy | Description |

|---|---|

| None | Stratégie d'équilibrage de charge globale par défaut. |

| FDO | Fail Over Only: Stratégie qui n'effectue pas d'équilibrage de charge. Cette stratégie utilise un seul chemin actif, les autres chemins sont des chemins d'accès de secours. |

| RR | Round Robin: Stratégie d'équilibrage de charge qui permet d'utiliser tous les chemins disponibles pour MPIO de manière équilibrée. |

| LQD | Least Queue Depth: Stratégie d'équilibrage de charge qui envoie les E/S vers le chemin ayant le moins de demandes d'E/S actuellement en attente. |

| LB | Least Blocks: Stratégie d'équilibrage de charge qui envoie les E/S vers le chemin ayant le moins de blocs de données en cours de traitement. |

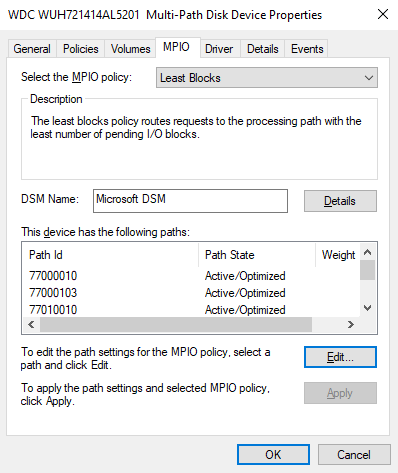

- Via Server Manager

Cette méthode n'est pas recommandée car elle nécessite de définir la stratégie pour chaque disque.

Vu que MPIO est déja installé, l'onglet MPIO est accessible dans les propriétés disque.

Ces trois étapes achevées, vous pouvez lister les disques :

Aller plus loin

Échangez avec notre communauté d'utilisateurs.