Comment installer un agent IA sur un VPS OVHcloud

Objectif

Ce guide explique comment déployer un agent IA local sur un VPS OVHcloud, sans dépendre du cloud de fournisseurs externes. Vous utiliserez pour cela un conteneur Docker prêt à l'emploi contenant un agent IA open source comme Open Interpreter, GPT4All ou Auto-GPT.

Découvrez comment déployer un agent IA comme Open Interpreter ou GPT4All sur un VPS OVHcloud.

Prérequis

- Disposer d'un VPS fonctionnel (Debian 11 ou supérieur recommandé)

- Disposer d'un accès administrateur (sudo) via SSH à votre serveur

- Python ≥ 3.10 installé sur le VPS

En pratique

Mettre à jour votre VPS et installer Python

Ouvrez un terminal et connectez-vous à votre VPS avec la commande suivante (en remplaçant IP_VPS par la véritable IP) :

Mettez à jour les paquets :

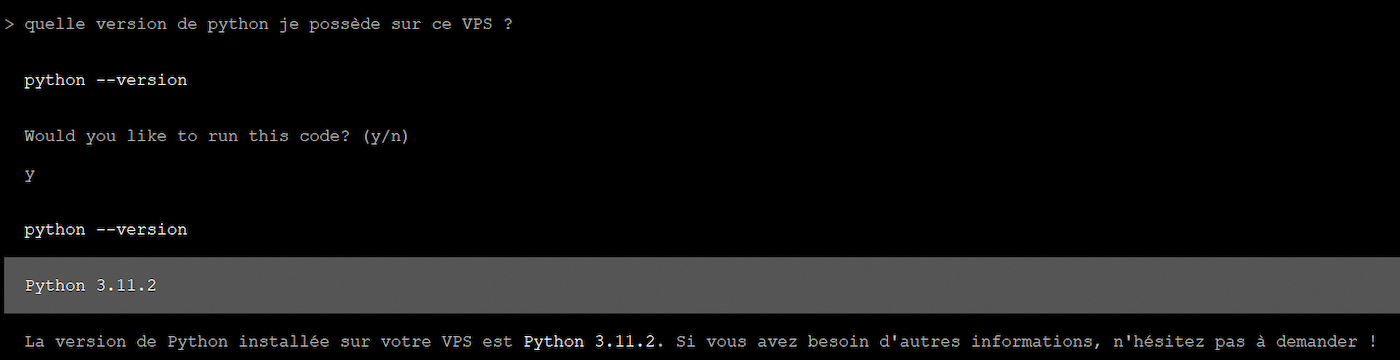

Vérifiez que Python ≥ 3.10 est installé :

Si nécessaire, installez Python 3.10+ et pip :

Créer un environnement virtuel et installer Open Interpreter

Les environnements récents limitent l’usage de pip globalement. Il est recommandé de créer et d'utiliser un environnement virtuel :

Installez Open Interpreter :

Configurer un modèle IA pour l’agent (local ou distant)

Option 1 – Utiliser OpenAI (GPT-4o, GPT-3.5, etc.)

Vous devez disposer d’une clé API OpenAI. Ajoutez-la lors du premier lancement ou en la définissant au préalable :

Suivez ensuite les instructions.

Option 2 – Utiliser un modèle local (via Ollama)

Si vous ne souhaitez pas utiliser OpenAI, exécutez un modèle local grâce à Ollama :

Cela vous proposera plusieurs options (Ollama, LM Studio, etc.). Nous vous recommandons d'utiliser Ollama, car il est facile à installer et compatible avec plusieurs modèles modernes comme llama3 ou mistral.

Installez Ollama :

Chargez le modèle :

Puis relancez :

Erreurs fréquentes

Model requires more system memory (6 GiB) than is available (1 GiB)

Cette erreur indique que votre VPS n’a pas assez de mémoire vive (RAM). Voici vos options :

- Opter pour un VPS disposant d'au moins 8 Go de RAM.

- Utiliser l'API OpenAI (voir

Option 1ci-dessus). - Utiliser un modèle plus léger, comme Mistral.

Tester votre agent IA

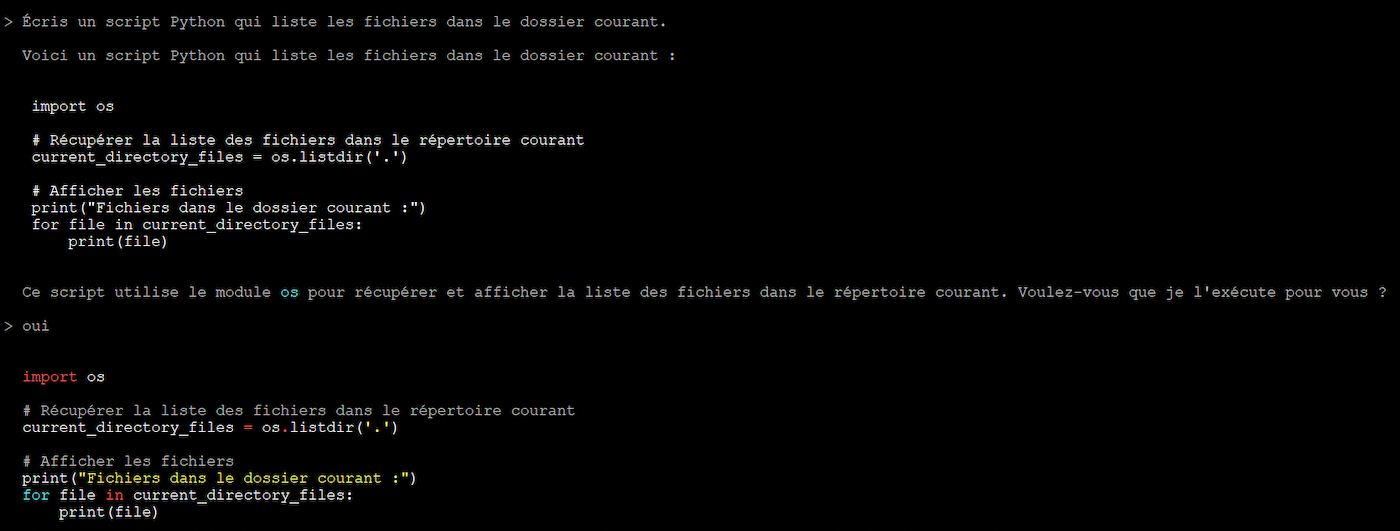

Testez les exemples d'utilisation suivants :

Exemple de réponse :

L’agent interprète votre demande, génère du code et l’exécute localement.

Exemple de réponse :

Conclusion

Grâce à ce guide, vous avez installé un agent IA sur votre VPS OVHcloud, capable d’exécuter des commandes à partir de simples instructions en langage naturel. Que vous ayez opté pour un modèle distant comme GPT-4 via OpenAI ou un modèle local comme Mistral via Ollama, vous disposez désormais d’un assistant intelligent directement dans votre terminal, sans dépendance à une interface web ou à un service tiers.

Aller plus loin

Pour des prestations spécialisées (référencement, développement, etc), contactez les partenaires OVHcloud

Échangez avec notre communauté d'utilisateurs.